联系电话:189 1137 7978用数字化推动组织进步,做客户长期信赖的朋友!

用友AI Lab全新发布的LOM本体大模型研究论文指出,当前大语言模型面临一道“概率墙”——单纯扩大参数规模,在逻辑一致性方面带来的收益正在递减。在复杂的图推理任务上,传统概率模型难以保证多步推理的逻辑严谨性,而LOM通过创新的技术架构,实现了超越参数规模增长的推理能力。

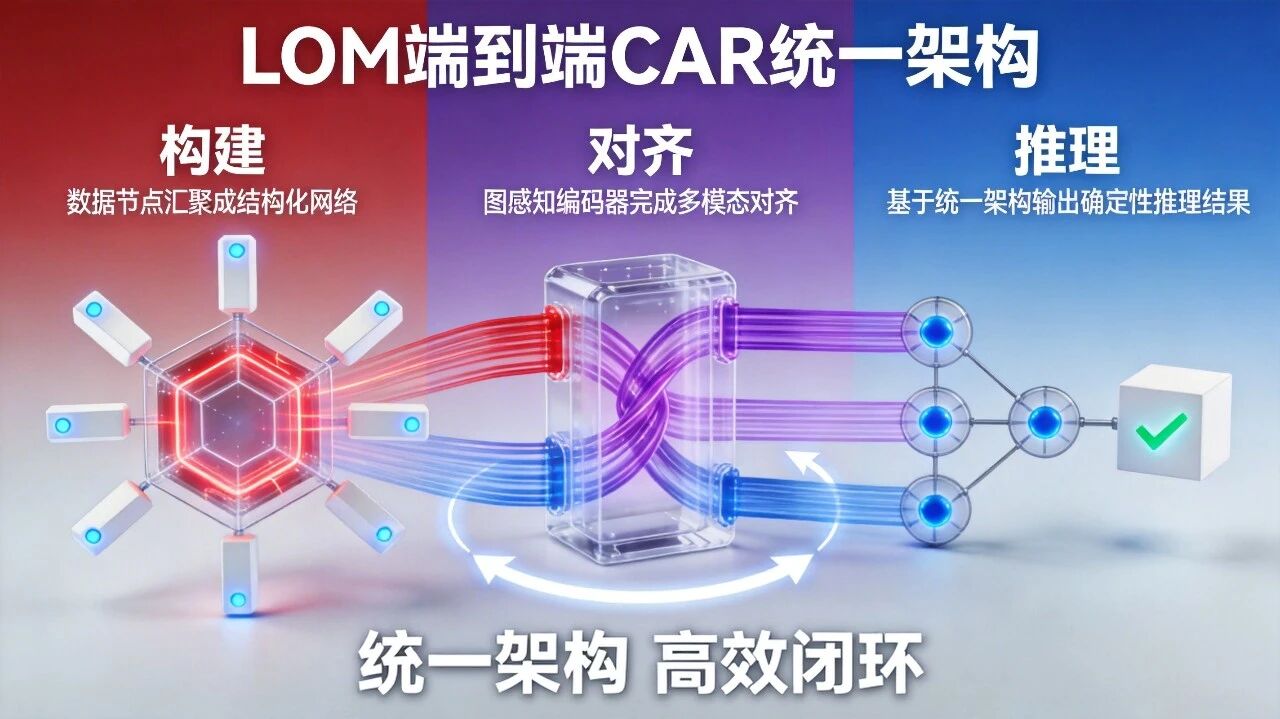

如何跨越这道墙?论文给出了LOM的三大核心技术突破:端到端统一架构、动态本体更新机制、强化学习优化推理。本文将深入解读,这三者如何协同,系统性地回应企业AI对“确定性”的终极追问。

01

企业AI规模化应用的四大”确定性“困境

在追求复杂企业环境下的确定性决策时,企业普遍面临四重困境。

1

有数据,没知识。

财务数据在ERP,客户数据在CRM,供应链数据在SCM——企业数据散落在孤岛,字段名只是一个标识符,其业务含义需要人工解读;同一概念在不同系统中使用不同名称。论文指出:“企业积累了海量数据,但其中大部分仍然混乱且实际上处于休眠状态。”

在小规模场景下,人工梳理或许还能应付。但当业务扩展到成百上千个系统、数以万计的业务概念时,没有任何团队能手工完成如此庞大的知识梳理工作。没有对业务逻辑的准确理解,推理就成了无源之水。

2

“流水线”架构放大了错误。

目前主流的神经符号方法大多采用“相互分离的管道”架构:一个模型负责抽取实体,另一个负责构建关系,第三个负责推理验证。论文明确指出,这种“相互分离的管道”不仅“导致显著的工程复杂性和碎片化”,更致命的是“难以避免错误传播”——第一阶段的小错误会在后续阶段被不断放大。

当数据规模扩大到数百万实体、数千万关系时,第一个模型的1%误差,到了推理阶段可能演变成30%的结论错误。分离管道式的设计,本质上是在大规模场景下层层放大不确定性。

3

AI很能“猜”,但不擅长“算”。

论文将大语言模型的根本局限定义为“概率墙”:单纯扩展参数规模,在逻辑一致性方面带来的收益持续递减。标准LLM擅长基于统计的“猜”,但“缺乏稳定的、时间独立的逻辑结构”,在需要多步逻辑推演的任务上,“经常导致复杂场景中的幻觉”。

在单点问答场景下,偶尔的“幻觉”可能只是闹个笑话。但在复杂推理中——比如需要跨10个环节、涉及上百个实体的供应链风险传导分析——概率模型的每一次“猜”都在累积不确定性。

4

业务天天变,AI跟不上。

企业数据是动态变化的。新订单产生,新合同签订,新供应商入库,旧关系失效。论文强调:“本体必须随着新数据的到达瞬间演化。”然而,传统方法每次更新都需要重新构建,成本高昂且滞后严重。

在低频变化的业务中,每日更新或许够用。但在高频交易的场景下,以小时计的更新延迟就意味着决策依据已经过时。当静态的知识基座面对动态的业务现实,基于过时知识的推理注定无法给出确定的答案。

这四重困境环环相扣,每一重都在复杂企业环境下被急剧放大,共同侵蚀着企业AI决策的确定性。

02

LOM的三大核心技术突破

针对上述困境,LOM在技术架构上实现了三项根本性突破。

1

端到端统一架构从源头消除错误传播

LOM将“构建-对齐-推理”(CAR)三个阶段集成于端到端的统一架构之中。与传统方法将这些视为单独的工程任务不同,LOM将它们集成到一个连贯的认知过程中,在单一连贯的架构中实现了本体构建、语义对齐和确定性推理的无缝集成。

这一设计的核心在于三个阶段互为支撑:构建阶段从原始数据中自主生成领域特定的本体;对齐阶段将抽象结构锚定在语义现实中;推理阶段在自构建的公理系统内执行确定性算法。

一体化设计从根本上消除了传统流水线中的错误传播。实验数据显示,LOM在多项推理任务上表现优异,LOM-4B平均准确率达93%,LOM-32B达94%,证明了端到端架构在处理多样化推理任务时的有效性。对于大规模企业环境,这意味着即使数据量激增,推理准确性也不会因组件间的信息损耗而衰减。

2

动态本体更新机制让AI与企业“同频共振”

LOM支持本体与实时数据同步演化,通过链接预测动态调整图结构。论文将对齐机制的核心功能概括为两点:一是将拓扑结构静态锚定在现实世界业务语义中,确保抽象节点对应具体实体;二是促进本体更新,允许图结构响应实时数据流入而动态适应。

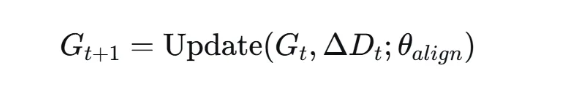

具体机制是:将企业环境概念化为稀疏图,节点代表带有密集文本属性的实体,边代表潜在关系。当新数据流入,模型通过链接预测判断图状态是否需要更新,实现增量状态变化。论文用公式描述这一机制:

该公式表示:模型能够根据新数据增量ΔDₜ实时调整知识结构Gₜ,确保逻辑宇宙与业务现实同步演化。

这一机制将概率噪声‘坍缩为确定性结构表示’。静态的本体无法支撑实时决策,而LOM支持动态增量更新,能够在秒级完成知识基座的同步。当新订单产生、新供应商入库时,知识基座实时演化,确保每一次推理都基于最新的业务现实。

3

强化学习优化推理在自建公理内执行确定性算法

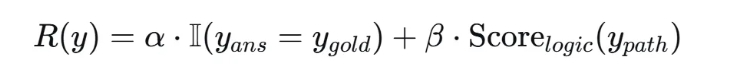

LOM引入强化学习让模型自主发现最优且逻辑严谨的推理路径。论文指出,在现实世界企业数据固有的嘈杂和模糊环境中,查询需要在基于内容的过滤和基于结构的演绎之间取得微妙的平衡,标准监督学习方法难以泛化。

为此,LOM采用GSPO算法,为每个查询生成多个候选推理轨迹,用奖励函数评估。奖励函数的设计兼顾答案准确性与推理路径的逻辑严谨性:

论文通过强化学习优化推理路径,有效提升了模型在复杂查询下的逻辑严谨性。这意味着,LOM不仅知道答案,更能展示出完整的、可追溯的推理链条——这正是企业敢在大规模场景下将关键决策交给AI的前提。

03

对企业AI选型的几点启示

论文基于大量真实企业数据进行严格实验验证,完整还原了企业真实数据环境的复杂性。这些数据为企业AI建设提供了三点关键启示。

1

架构创新比参数规模更有价值。

LOM-4B以4B参数实现了超越数十亿乃至百亿参数模型的逻辑能力——本体补全任务链接预测准确率88.8%,图推理任务中LOM-4B平均准确率93%,LOM-32B达94%。相比之下,Qwen2.5-32B在最小生成树任务上准确率为0,DeepSeek-V3.2在最短路径任务上仅0.09。实验印证了论文的核心观点:“架构创新而非简单缩放是关键”。

2

动态适应能力是应对实时决策的关键。

LOM支持动态本体更新,能够随实时数据流入同步演化。增量更新机制的效率,使得“活”的本体成为技术现实。未来企业AI的核心资产,是能够实时映照、同步演化的动态知识基座,而非静态知识库。

3

可追溯的推理路径是实现企业级信任的基石。

LOM在自构建的逻辑公理内运行形式化算法,结果具有数学确定性。同时,其通过强化学习优化的推理路径是可追溯、可审计的。当系统建议“更换供应商A”时,决策者能够清晰地复现完整的逻辑链。这种“白盒”特性,是AI融入高风险、高价值企业决策流程的信任基石。

对于渴求可靠智能的企业而言,LOM的三大突破构建了一条实现企业级确定性推理的可行路径。当AI能够从混沌数据中自主构建逻辑体系,并用严谨的推导回应每一个追问,企业才敢把关键决策真正托付。